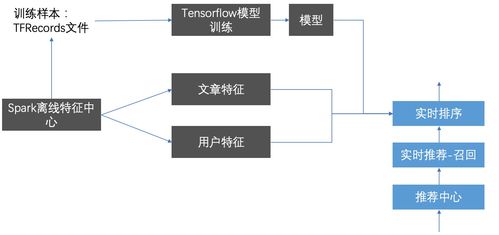

TFRecords 高效數據處理與存儲的關鍵支持服務

在機器學習與深度學習項目的生命周期中,數據處理的效率和質量往往是決定模型成敗的關鍵因素之一。面對海量、多源、結構各異的訓練數據,如何高效地進行組織、存儲、讀取和傳輸,是工程師們必須解決的核心問題。TensorFlow 框架提供的 TFRecords 格式,正是為解決這一系列挑戰而設計的強大數據處理與存儲支持服務。

一、 TFRecords 的核心價值:專為 TensorFlow 優化的存儲格式

TFRecords 是 TensorFlow 官方推薦的一種二進制文件格式,它將數據序列化為 tf.train.Example Protocol Buffer 消息進行存儲。其核心設計目標在于與 TensorFlow 的數據讀取管道(tf.data API)實現無縫、高效集成。相比直接讀取原始圖像、CSV 或 JSON 文件,TFRecords 格式具有顯著優勢:

- 高效的存儲與讀取:二進制格式體積更小,I/O 效率更高,特別適合在分布式訓練環境中進行快速的數據加載,有效避免了小文件讀寫帶來的性能瓶頸。

- 序列化存儲:能夠將圖像數據、標簽、文本、數值特征等異構數據統一封裝在一條記錄中,簡化了數據管理邏輯。

- 與

tf.data管道深度集成:TFRecords 文件可以方便地使用tf.data.TFRecordDataset進行讀取,并配合map、shuffle、batch、prefetch等操作,構建出高效、靈活的數據輸入流水線,使得 CPU 的數據預處理與 GPU 的模型計算能夠充分并行。

二、 數據處理流程:從原始數據到 TFRecords

構建 TFRecords 文件是一個標準化的數據處理流程,主要包含以下步驟:

- 數據準備與解析:從原始來源(如數據庫、文件系統、網絡)收集數據,并進行必要的清洗、歸一化或標注。

- 特征字典構建:將每個樣本(如圖像及其標簽)的所有信息,按照 TensorFlow 支持的數據類型(

BytesList,FloatList,Int64List)構建為一個特征字典。 - 序列化為 Example:使用

tf.train.Example將特征字典序列化。 - 寫入 TFRecords 文件:將序列化后的

Example對象寫入一個或多個 TFRecords 文件。通常建議將大數據集切分為多個文件(Sharding),以便于并行讀取和分布式處理。

這個流程本身可以作為一項重要的數據支持服務,通過自動化腳本或數據流水線工具,將雜亂的數據源轉化為模型訓練可直接消費的高質量、標準化“燃料”。

三、 存儲支持服務:TFRecords 在工程實踐中的角色

在大型項目或企業級機器學習平臺中,圍繞 TFRecords 可以構建一套完整的數據存儲支持服務體系:

- 標準化與版本管理:TFRecords 文件格式統一,便于對訓練數據集進行版本控制,追蹤不同版本數據與模型性能的對應關系。

- 高效緩存與分發:二進制文件適合作為構建數據緩存層的基礎格式。在云端訓練場景中,可以先將預處理好的 TFRecords 文件存儲在對象存儲(如 AWS S3, Google Cloud Storage)中,訓練時再快速流式讀取到計算實例,減少重復預處理開銷。

- 數據管道即服務:將生成 TFRecords 的流程封裝為可配置的、可調度的服務。數據工程師只需提交數據源和配置(如圖像尺寸、編碼方式),該服務即可自動完成從原始數據到標準化 TFRecords 的轉換,供算法團隊隨時取用。

- 性能優化關鍵:通過調整 TFRecords 文件的大小、數量,以及配合

tf.dataAPI 的并行讀取、預取等策略,可以最大化 I/O 吞吐量,確保昂貴的 GPU 計算資源不會因數據供給不足而閑置。

四、 與展望

TFRecords 遠不止是一種文件格式,它是連接原始數據與 TensorFlow 計算圖的高性能橋梁,是構建工業化機器學習流水線不可或缺的一環。它將數據處理中的存儲、序列化、讀取等復雜細節封裝起來,讓算法開發者能更專注于模型本身。

盡管 PyTorch 等框架有其各自的數據加載方式(如 Dataset 和 DataLoader),但 TFRecords 所體現的設計思想——即通過標準化、序列化的存儲格式來優化 I/O 性能,并與框架原生數據工具深度集成——具有普遍的借鑒意義。隨著機器學習項目規模不斷擴大,將數據處理與存儲作為一項核心支持服務來系統化地建設和優化,已成為提升團隊整體效率和模型迭代速度的必然選擇。

最新產品